robots.txtは、検索エンジンのクローラーに対して「どのページをクロールして良いか・ダメか」を指示する重要なファイルです。

正しく設定することで、不要なページへのクロールを防ぎ、重要なページに評価を集中させることができます。

しかし、設定を間違えるとサイト全体が検索されなくなるリスクもあるため、慎重に扱う必要があります。

この記事では、初心者でも分かるように、robots.txtの基本から書き方、WordPressでの設定方法までプロ目線で解説します。

結論

robots.txtは「クローラーの動きを制御するための設定ファイル」です。基本ルールは以下です。

・見せたくないページ → クロール禁止

・重要なページ → クロール許可

ただし、robots.txtは「インデックス制御ではない」ため、noindexとの違いを理解することが重要です。

robots.txtとは?

robots.txtとは、検索エンジンのクローラー(Googlebotなど)に対してアクセス制御を行うためのファイルです。

サイトのルートディレクトリに設置され、以下のように記述します。

https://example.com/robots.txtrobots.txtの役割

robots.txtには以下の役割があります。

・不要ページのクロールを防ぐ

・サーバー負荷の軽減

・クロールの最適化

重要なページにクロールを集中させることで、SEO効果を高めることができます。

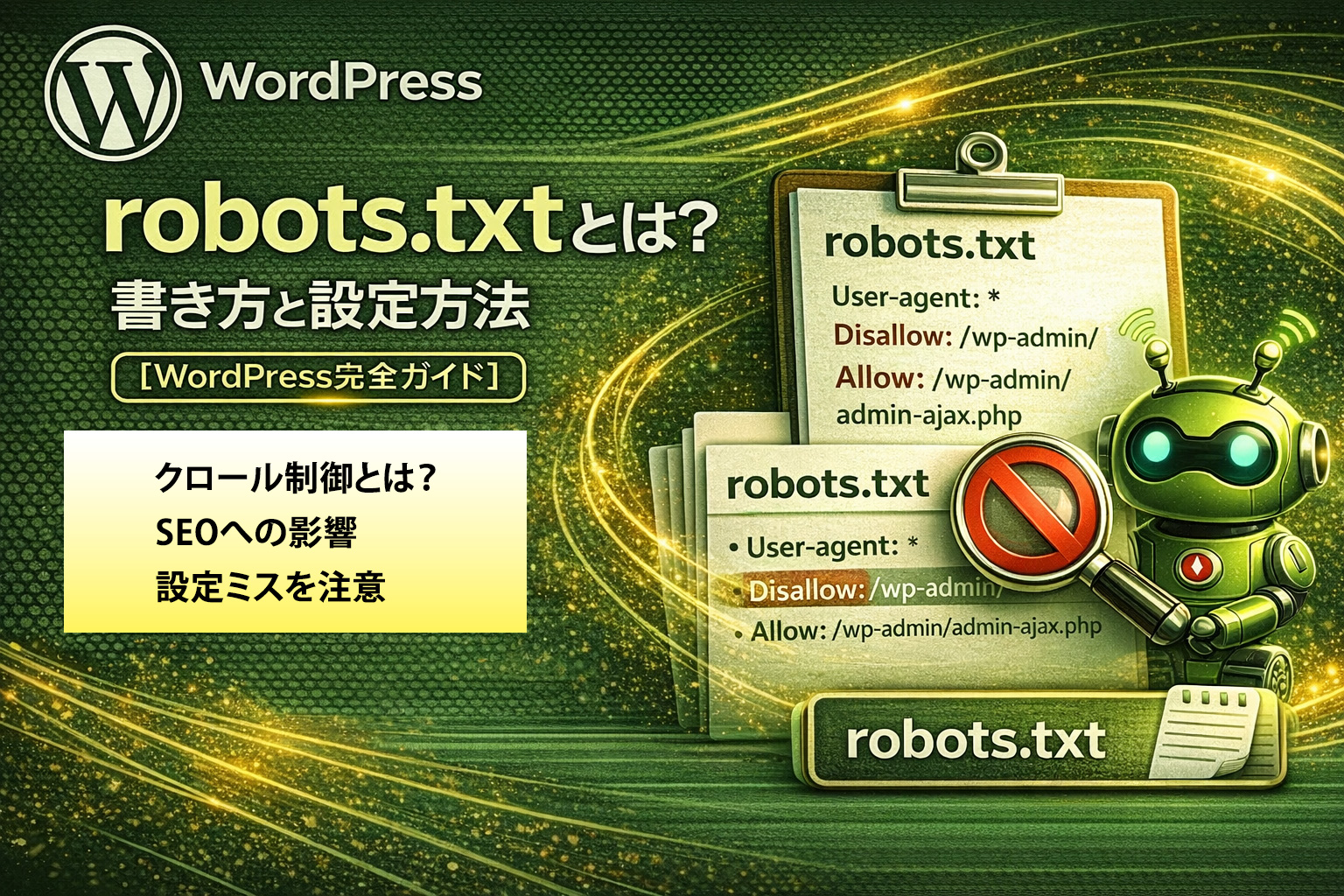

robots.txtの基本構文

基本的な書き方は以下です。

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.phpUser-agent:対象クローラー

Disallow:クロール禁止

Allow:クロール許可

WordPressの推奨設定

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Sitemap: https://example.com/sitemap.xmlポイント

・管理画面はクロール不要

・サイトマップは必ず記載

robots.txtで禁止すべきページ

| 管理画面 | 検索結果ページ | パラメータURL |

|---|---|---|

| /wp-admin/ | /?s= | /?utm= |

robots.txtで禁止してはいけないもの

| CSS・JS | 重要ページ |

|---|---|

| /wp-content/ 正しくレンダリングされなくなる | 記事・LP・トップページ |

noindexとの違い

| 項目 | robots.txt | noindex |

|---|---|---|

| 役割 | クロール制御 | インデックス制御 |

| SEO | 間接影響 | 直接影響 |

canonicalとの違い

robots.txt → クロール制御

canonical → URL統一

よくあるミス

サイト全体をブロック

Disallow: /完全NG(インデックス消える)

noindexの代わりに使う

robots.txtでは検索結果から消せない

設定忘れ

不要ページがクロールされ続ける

WordPressでの設定方法

直接設置(FTP)

public_htmlにrobots.txtをアップロード

プラグイン(AIOSEO)

robots.txtエディタで編集可能

SEOでの正しい使い方

robots.txtは「クロール最適化のための戦略ツール」です。

クロール集中

重要ページにクローラーを誘導

無駄排除

低品質ページのクロールを防ぐ

サイト設計

内部SEOの最適化

最後に

robots.txtは、クローラーの動きを制御する重要なSEO設定です。

正しく使うことで、クロール効率を高め、SEO評価を最大化することができます。

ただし、設定ミスの影響も大きいため、基本ルールをしっかり理解して運用することが重要です。

よくある質問(FAQ)

- Qrobots.txtで検索結果から消せますか?

- A

消せません(noindexが必要です)

- Q設定しないとどうなる?

- A

不要ページもクロールされます

- Q初心者でも必要?

- A

基本設定は必須です